Secondo i dati condivisi con The Cube, circa 200 clip Ice - generate dall'intelligenza artificiale - hanno ottenuto milioni di visualizzazioni sui social media

L’emittente pubblica tedesca ZDF ha richiamato a fine febbraio una corrispondente dagli Stati Uniti dopo che un filmato generato dall’intelligenza artificiale è stato trasmesso in un servizio dedicato agli agenti dell’Immigration and Customs Enforcement (Ice).

PUBBLICITÀ

PUBBLICITÀ

PUBBLICITÀ

PUBBLICITÀ

Il video mostrava alcuni bambini aggrappati alla madre mentre veniva arrestata da agenti federali. Nelle immagini era visibile il watermark di Sora, lo strumento di generazione video sviluppato da OpenAI, chiaro indizio della natura artificiale del contenuto. L’emittente si è scusata pubblicamente per l’errore.

L’inchiesta di The Cube

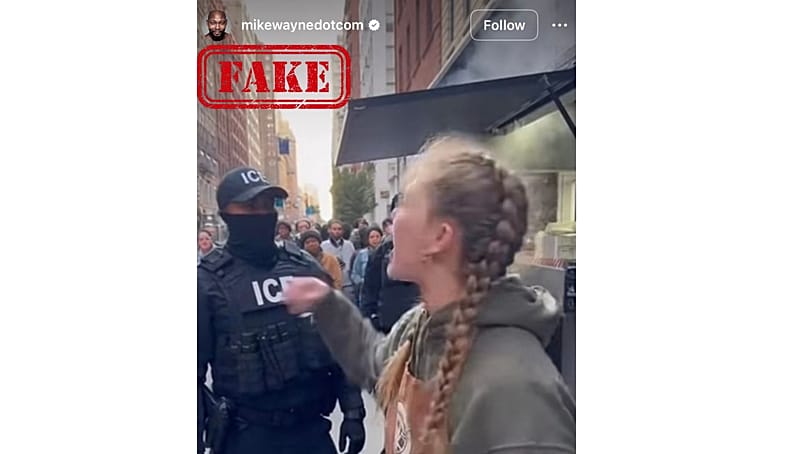

Secondo quanto ricostruito da Euronews attraverso il suo team di fact-checking The Cube, il filmato è solo uno tra migliaia di clip generate dall’IA che ritraggono agenti dell’Ice in situazioni drammatiche o compromettenti e che stanno inondando i social media, spesso senza alcuna etichetta che ne segnali l’origine artificiale.

I dati forniti a The Cube dalla società di rilevamento dell’intelligenza artificiale TruthScan indicano oltre 200 brevi video provenienti da un singolo account Instagram. Le clip mostrano agenti dell’Ice inseguiti da insegnanti, coinvolti in risse nei bar o addirittura arrestati da agenti del New York City Police Department nella metropolitana di New York.

I video seguono uno schema coerente: sono brevi, altamente emotivi e costruiti per suscitare reazioni immediate. The Cube ha verificato che l’account continua a pubblicare in massa nuovi contenuti generati dall’IA, alcuni dei quali raggiungono migliaia, altri milioni di visualizzazioni.

Indizi tecnici e assenza di watermark

Diversi dettagli tradiscono la natura sintetica dei filmati. In una clip, ad esempio, il vapore sembra attraversare una superficie solida durante un confronto tra un agente dell’Ice e una persona, un’anomalia visiva tipica dei contenuti generati artificialmente.

Secondo TruthScan, ogni video analizzato ha una durata esatta di 10 o 15 secondi, caratteristica che suggerisce l’utilizzo del modello Sora 2, che offre proprio queste opzioni di lunghezza predefinite. A differenza di altri contenuti IA che riportano watermark evidenti, la maggior parte di queste clip non contiene indicazioni sulla loro origine.

Analogamente, nel novembre dello scorso anno, 404 Media ha riferito che i video generati dall'intelligenza artificiale di agenti dell'ICE provenienti da un account Facebook sono diventati virali (fonte in inglese), con uno che ha generato 4 milioni di visualizzazioni da solo. I video sono stati poi rimossi.

Il rischio per la fiducia pubblica

Per gli esperti, il problema va oltre il singolo errore editoriale. Ari Abelson, cofondatore di OpenOrigins, società specializzata nell’autenticità dei media e nel rilevamento dei deepfake, avverte che la proliferazione di contenuti falsi su temi politicamente sensibili può minare la fiducia collettiva.

“Esiste un rischio significativo per le reazioni pubbliche alle azioni delle forze dell’ordine, sia in senso negativo che positivo”, ha spiegato Abelson a The Cube. “È una preoccupazione per le forze dell’ordine che vogliono mantenere la fiducia, ma anche per le istituzioni che devono poterle ritenere responsabili quando oltrepassano i limiti”.

I contenuti generati dall’IA non restano confinati ad account anonimi. A gennaio, la Casa Bianca ha pubblicato un’immagine digitalmente alterata dell’attivista e avvocata Nekima Levy Armstrong dopo il suo arresto durante una protesta legata all’Ice in Minnesota. Un’analisi ha evidenziato che nella versione diffusa la Armstrong appariva con la pelle più scura e visibilmente singhiozzante rispetto all’immagine originale.

Alle critiche per la manipolazione ha risposto il vicedirettore delle comunicazioni Kaelan Dorr, affermando in un post che “l’applicazione della legge continuerà”. Armstrong si è detta “disgustata” dalla pubblicazione dell’immagine.

Secondo Abelson, la differenza rispetto alle tradizionali vignette politiche sta nell’iperrealismo dei video generati dall’IA. “Gli spazi sociali e informativi richiedono una cosa: la capacità di dimostrare che una foto o un video siano reali, così da poter riconoscere quelli falsi come finzioni e comprendere la gravità degli eventi autentici”, ha concluso.