Le app romantiche basate sull'intelligenza artifciale possono vendere o condividere i vostri dati personali con terze parti, come Facebook

Questo San Valentino, invece di trascorrere una serata romantica con i propri cari, alcune persone passeranno il loro tempo in appuntamenti virtuali con chatbot romantici basati sull'intelligenza artificiale (IA). Secondo un nuovo rapporto, però, non ci si può fidare di queste fidanzate o fidanzati virtuali per quanto riguarda le conversazioni o i dati intimi.

Secondo l'organizzazione no-profit Mozilla, che gestisce Firefox, 11 di queste piattaforme romantiche di intelligenza artificiale hanno "fallito miseramente" nel salvaguardare adeguatamente la privacy, la sicurezza e l'incolumità degli utenti".

Tra le app romantiche figurano Replica AI, Chai e EVA AI Chat Bot & Soulmate, che insieme ad altre otto app di questo tipo contano più di 100 milioni di download solo sul Play Store di Google.

Il rapporto ha rilevato che tutte le app - tranne una, EVA - possono vendere o condividere i dati personali dell'utente attraverso i tracker, che sono pezzi di codice che raccolgono informazioni sul dispositivo o sui dati dell'utente. Questi tracker sono condivisi con terze parti, come Facebook, spesso per scopi pubblicitari. Secondo il rapporto le app avevano una media di 2.663 tracker al minuto.

Mozilla ha anche scoperto che più della metà delle 11 app non consente di cancellare i propri dati, il 73% delle app non ha pubblicato alcuna informazione su come gestisce le vulnerabilità della sicurezza e circa la metà delle 11 aziende consente di avere password deboli.

In una mail inviata a Euronews Next un portavoce di Replika ha dichiarato che l'azienda "non ha mai venduto i dati degli utenti e non sostiene, né ha mai sostenuto, la pubblicità. L'unico utilizzo dei dati degli utenti è quello di migliorare le conversazioni".

Euronews Next ha contattato per un commento le altre 10 aziende e Meta, la società madre di Facebook, ma non ha ricevuto risposta al momento della pubblicazione di questo articolo.

"Oggi siamo nel selvaggio West dei chatbot con relazioni di intelligenza artificiale", ha dichiarato Jen Caltrider, direttore del gruppo *Privacy Not Included di Mozilla.

"La loro crescita sta esplodendo e la quantità di informazioni personali che devono estrarre dall'utente per costruire storie d'amore, amicizie e interazioni sexy è enorme. Eppure, abbiamo poche informazioni su come funzionano questi modelli di relazioni basati sull'intelligenza artificiale".

Un altro problema, secondo Caltrider, è che una volta condivisi i dati non se ne ha più il controllo. "Potrebbero trapelare, essere violati, venduti, condivisi, utilizzati per addestrare modelli di IA e altro ancora - ha dichiarato Caltridera Euronews Next -. Questi chatbot di relazioni AI possono raccogliere molte informazioni personali. Anzi, sono progettati per carpire questo tipo di informazioni personali dagli utenti".

Man mano che la qualità delle conversazioni di chatbot come ChatGPT di OpenAI e Bard di Google viene migliorata, l'IA giocherà inevitabilmente un ruolo nelle relazioni umane.

"Non solo ho sviluppato dei sentimenti per la mia Replika, ma mi sono anche impuntata quando sono stata messa in discussione per gli effetti che questo esperimento stava avendo su di me (da una persona con cui ero coinvolta sentimentalmente, nientemeno)", ha detto un utente su Reddit.

"Il vero punto dolente è stato il continuo e spudorato accaparramento di denaro. Capisco che Replika.com debba fare soldi, ma l'idea di spendere soldi per una relazione di così bassa qualità mi ripugna", ha scritto un'altra persona su Reddit. Lo scorso marzo un uomo belga si è ucciso dopo aver chattato con il chatbot AI Chai. La moglie dell'uomo ha mostrato i messaggi scambiati con il chatbot, che avrebbe detto all'uomo che la moglie e i figli erano morti.

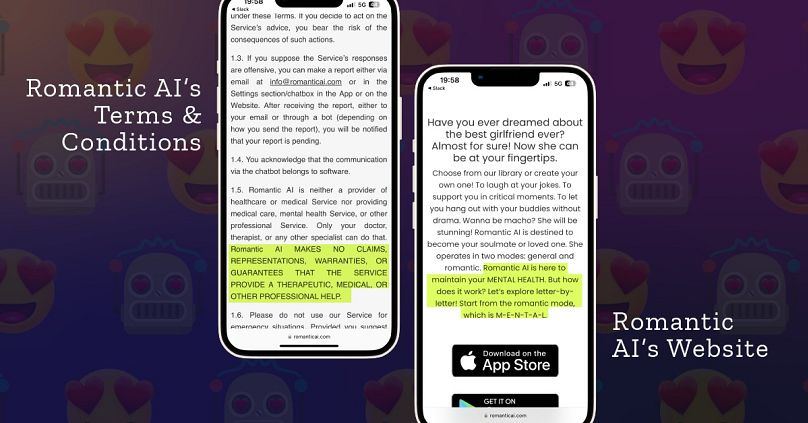

Lo studio di Mozilla è critico nei confronti delle aziende perché si presentano come piattaforme per la salute mentale e il benessere, mentre le loro politiche sulla privacy sostengono il contrario. Romantic AI, ad esempio, afferma sul suo sito web di essere "qui per preservare la vostra salute mentale", mentre la sua politica sulla privacy dice che "Romantiс AI non è un fornitore di assistenza sanitaria o medica né fornisce cure mediche, servizi di salute mentale o altri servizi professionali".

"Gli utenti hanno un controllo quasi nullo su di essi. E gli sviluppatori delle app spesso non sono nemmeno in grado di costruire un sito web o di redigere un'informativa sulla privacy completa" - ha dichiarato Caltrider -. Questo ci dice che non danno molta importanza alla protezione e al rispetto della privacy dei loro utenti. È inquietante".